Apple이 새롭게 발표한 'CSAM(아동성학대 자료) 확산방지를 위한 시도'에 대한 비난이 쇄도하자 새롭게 상세한 설명자료를 발표했습니다. 보도에 따르면, Apple은 이번 사업에 대해 '오해를 받고 있다'는 입장입니다.

Apple to only seek abuse images flagged in multiple nations - Security - Cloud - Software - iTnews

https://www.itnews.com.au/news/apple-to-only-seek-abuse-images-flagged-in-multiple-nations-568625

Apple to only seek abuse images flagged in multiple nations

After criticism of its image detection plans.

www.itnews.com.au

Apple Outlines Security and Privacy of CSAM Detection System in New Document - MacRumors

https://www.macrumors.com/2021/08/13/apple-child-safety-features-new-details/

Apple Outlines Security and Privacy of CSAM Detection System in New Document

Apple today shared a document that provides a more detailed overview of the child safety features that it first announced last week, including design...

www.macrumors.com

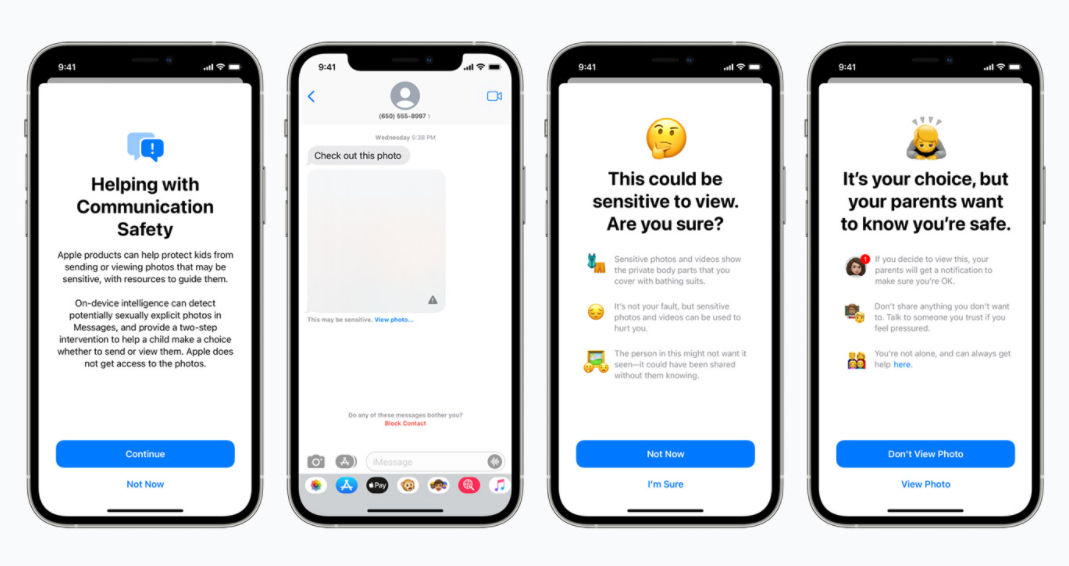

2021년 8월 5일, Apple은 새로운 CSAM 확산방지를 위한 시도로서 '메시지앱에서 성적으로 노골적인 이미지를 송수신할 때 경고를 표시', 'Siri에게 CSAM 관련 검색을 시켰을 때 경고를 표시', 'iCloud에 저장된 이미지를 스캔하여 알려진 CSAM 이미지가 존재하는지 여부를 체크'라는 3가지 시책을 도입할 예정이라고 발표했습니다.

Child Safety - Apple

https://www.apple.com/child-safety/

Child Safety

Expanded Protections for Children

www.apple.com

Apple plans to scan US iPhones for child abuse imagery | Ars Technica

https://arstechnica.com/information-technology/2021/08/apple-plans-to-scan-us-iphones-for-child-abuse-imagery/

Apple plans to scan US iPhones for child abuse imagery

Security researchers raise alarm over potential surveillance of personal devices.

arstechnica.com

그러나 이 3가지 중 iCloud에 저장된 이미지를 스캔하는 시책에 대해 사용자의 보안 및 개인정보를 침해한다고 비난이 쇄도했고 외부뿐만 아니라 사내에서도 반발의 목소리가 높아진 것 외에도 '데이터베이스를 CSAM 이미지 외의 것으로 대체하면 사실상 어떤 종류의 이미지도 검열하는 시스템이 될 수 있다'는 비판도 크게 보도되었습니다.

If You Build It, They Will Come: Apple Has Opened the Backdoor to Increased Surveillance and Censorship Around the World | Electronic Frontier Foundation

https://www.eff.org/deeplinks/2021/08/if-you-build-it-they-will-come-apple-has-opened-backdoor-increased-surveillance

If You Build It, They Will Come: Apple Has Opened the Backdoor to Increased Surveillance and Censorship Around the World

Apple’s new program for scanning images sent on iMessage steps back from the company’s prior support for the privacy and security of encrypted messages. The program, initially limited to the United States, narrows the understanding of end-to-end encryp

www.eff.org

이러한 비판에 Apple은 기존의 공식발표나 공식 FAQ에 더해 새롭게 '상세설명 자료'를 발표했습니다.

Protections Against Attacks and Misuse of Apple's Child Safety Features - Security_Threat_Model_Review_of_Apple_Child_Safety_Features.pdf

https://www.apple.com/child-safety/pdf/Security_Threat_Model_Review_of_Apple_Child_Safety_Features.pdf

이 자세한 설명자료의 내용은 기본적으로 이미 발표된 공식발표와 마찬가지로, 주로 문제의 시책은 'iCloud의 포토 라이브러리의 사진을 스캔하는 것이 아니라, 사진의 지문으로 알려진 아동포르노 이미지의 지문과 대조한다'는 것이었지만, 새롭게 '인간에 의한 육안검사를 실시하는 지문일치 매수 임계값은 30장을 예정하고 있지만 향후 이 임계값은 줄어들 가능성이 있다'며 '이 기능을 지원하는 iOS · macOS 시스템의 각 버전에 대한 CSAM 해시 데이터베이스의 루트해시 등 지원 문서를 웹사이트에 공개한다'라는 내용이 추가되어 있습니다.

2021년 8월 13일 The Wall Street Journal이 소프트웨어 엔지니어링 담당 수석부사장 크레이그 페데리히 씨와의 인터뷰에서 그는 문제의 시책에 대해 "사람들이 우려를 준 가장 큰 요인은 그 계획의 발표방법"이라고 지적했습니다.

이번 발표는 재차 계획의 세부사항을 설명함으로써 개인정보보호 등의 문제에 대한 우려를 불식시킬 목적이 있다고 보입니다.

'IT' 카테고리의 다른 글

| 누드사진을 얻기 위해 iCloud에서 62만 장 이상의 사진을 훔친 남성을 체포 (0) | 2021.08.26 |

|---|---|

| 6000억 원 상당의 암호화자산을 DeFi에서 훔친 해커가 전액을 반환하게 된 경위 (0) | 2021.08.25 |

| 세계적으로 HDD · SSD 품귀현상을 일으킨 암호화자산 'Chia' (0) | 2021.08.23 |

| Adobe, 1조 4000억 원으로 클라우드 동영상 협업도구 'Frame.io'를 인수 (0) | 2021.08.20 |

| 6000억 원 상당의 암호화자산을 훔친 해커가 40%를 반환...추적의 용이성이 이유일 가능성 (0) | 2021.08.15 |

| Samsung, 스마트워치 'Galaxy Watch 4/Watch4 Classic'을 발표 (0) | 2021.08.14 |

| 역대 최고액인 총 6000억 원의 암호화자산이 해킹 당해 (0) | 2021.08.13 |

| Xiaomi가 Spot 같은 애완동물 로봇 'CyberDog'와 신형 스마트폰 'Xiaomi MIX 4'를 발표 (0) | 2021.08.11 |